[大语言模型] Mistral 7B 模型介绍

Mistral人工智能团队很自豪地发布了Mistral 7B,这是迄今为止最强大的语言模型。

Mistral 7B 简述

Mistral 7B是一个7.3B参数模型,它:

- 在所有基准测试中均超过Llama 2 13B

- 在许多基准测试中表现超过Llama 1 34B

- 接近CodeLlama 7B的代码性能,同时保持良好的英语任务

- 使用分组查询注意力(GQA)进行更快的推理

- 使用滑动窗口注意力(SWA)以较小的成本处理较长的序列

- 我们将在Apache 2.0许可证下发布Mistral 7B,它可以不受限制地使用。

- 下载它并在任何地方(包括本地)使用我们的参考实现,

- 使用vLLM推理服务器和skypilot在任何云(AWS/GCP/Azure)上部署它,

- 在HuggingFace上使用。

Mistral 7B很容易在任何任务中进行微调。作为演示,我们提供了一个针对聊天进行微调的模型,它的性能优于Llama 2 13B聊天。

【语音处理】语音转文本|使用““Faster-Whisper”快速获得任何语言的大型音频文件的转录

【语音识别】使用Whisper Large V3从音频或视频内容进行疯狂的快速文本转录

介绍

转录服务在各种行业中被用来将音频或视频内容转换为文本。从转录服务中受益的一些行业包括:

医疗保健专业人员

医疗转录在医疗保健行业发挥着至关重要的作用,可以高精度地转录医生的记录并维护医疗记录。

法律/法律行业

律师事务所、律师助理、法庭记者和律师将转录服务用于法律目的,如转录证词和法庭听证会。

企业

企业使用转录服务将董事会会议、会议、采访和其他活动转录成无错误的转录本,以便更好地决策和将来参考。

媒体与大众传播

媒体专业人员,包括记者、视频制作人、电影制作人和文案,使用转录服务为文章、新闻稿和字幕转录采访和其他内容。

数字营销

数字营销人员和内容战略家使用转录师将播客、网络研讨会和其他材料转换为文本,用于博客文章和内容创作。

其他行业

其他受益于转录服务的行业包括市场研究人员、视频和音频播客、自由撰稿人、作家和主讲人。

【人工智能】Whisper v3 OpenAI语音转文本模型:完整指南

你猜怎么着?Sam Altman刚刚在DevDay主题演讲中透露了一些很棒的东西,那就是来自OpenAI的开源Whisper v3。这不仅仅是对已经令人印象深刻的Whisper v2的升级;这就像是进入了语音识别的未来。

可以将大v3想象成您熟悉的语音转文本工具,但它功能强大,能流利地使用多种语言。现在,这很重要,对吧?

但最棒的是,你不需要一些高端装备就可以使用它。如果你担心你的设置可能跟不上,我们会为你提供Replicate。

无论你家里有什么技术,这都是你体验大v3所有酷炫功能的方式。

那么,准备好看看Whisper large v3是怎么回事了吗?让我们深入了解一下为什么这是镇上的热门话题!

【AI应用】初窥Windows AI 工作室

微软的桌面人工智能开发环境提供了早期预览,可以让您构建在PC和移动设备上运行的小型语言模型。

微软利用其Ignite 2023活动中以开发者为中心的部分介绍了一系列人工智能开发工具。Azure AI Studio使用Azure OpenAI模型或其他模型支持云托管应用程序的大规模人工智能开发,而Copilot Studio则通过OpenAI支持的“增强”扩展了旧的Power Virtual Agents低代码人工智能工具

微软还宣布了第三个工具,但它花了一段时间才出现在开发者的电脑上。该工具是Windows AI Studio,现在可以预览。让我们来看看。

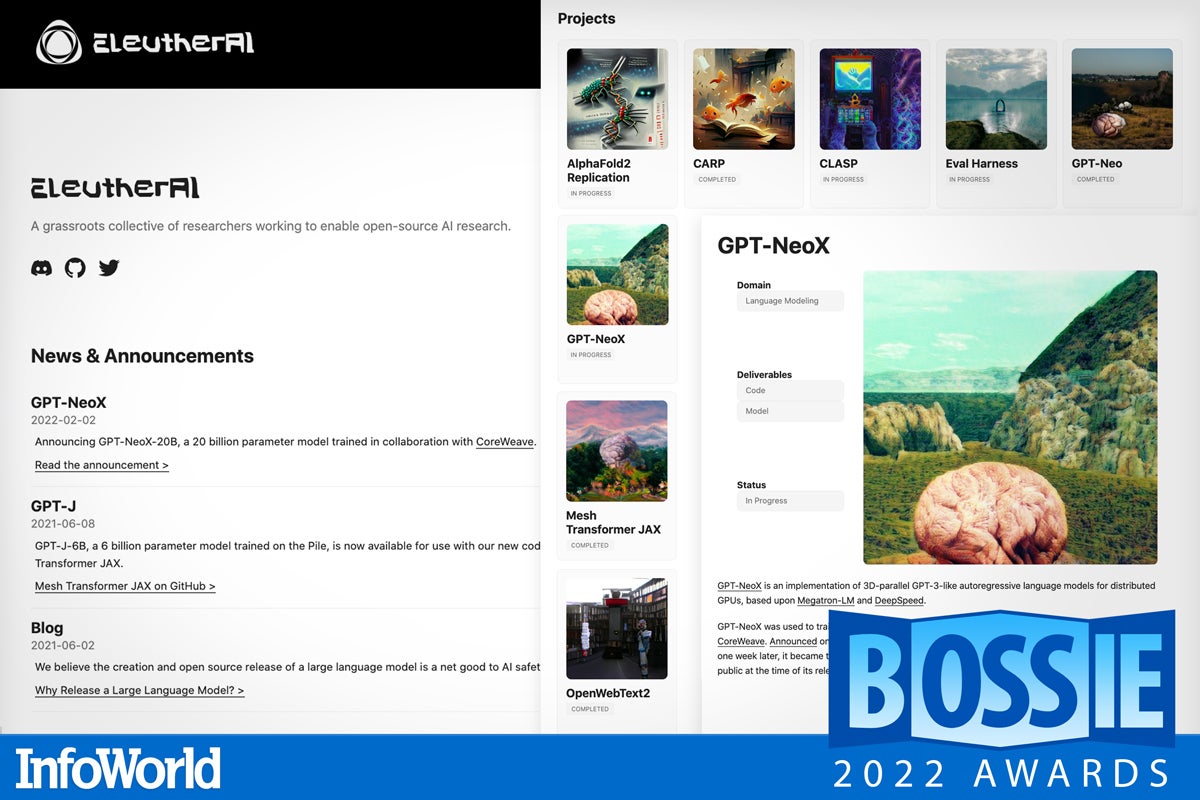

【开源软件】最好的开源软件-2022-第28名 EleutherAI

GPT-NeoX-20B是一个新的200亿参数的自然语言处理模型,由早期GPT-J的发行商EleutherAI创建,这是一个60亿参数的模型。与OpenAI的GPT-3相比,这些模型可能看起来很小,GPT-3有1750亿个参数,但它们使用LAMBADA、Winogrande、Hellaswag和其他数据集取得了强大的基准测试结果。你可以测试GPT-J的句子完成,并执行更高级的NLP任务,如翻译和分类。

EleutherAI推动开源如此强大的模型的背后是什么?该项目的创始人之一Conor Leahy解释道,“我们必须把人工智能视为思维与我们不同的奇怪外星人。”目标是让尽可能多的研究人员能够使用这项技术,这样我们就可以学会如何控制它。

——Isaac Sacolik

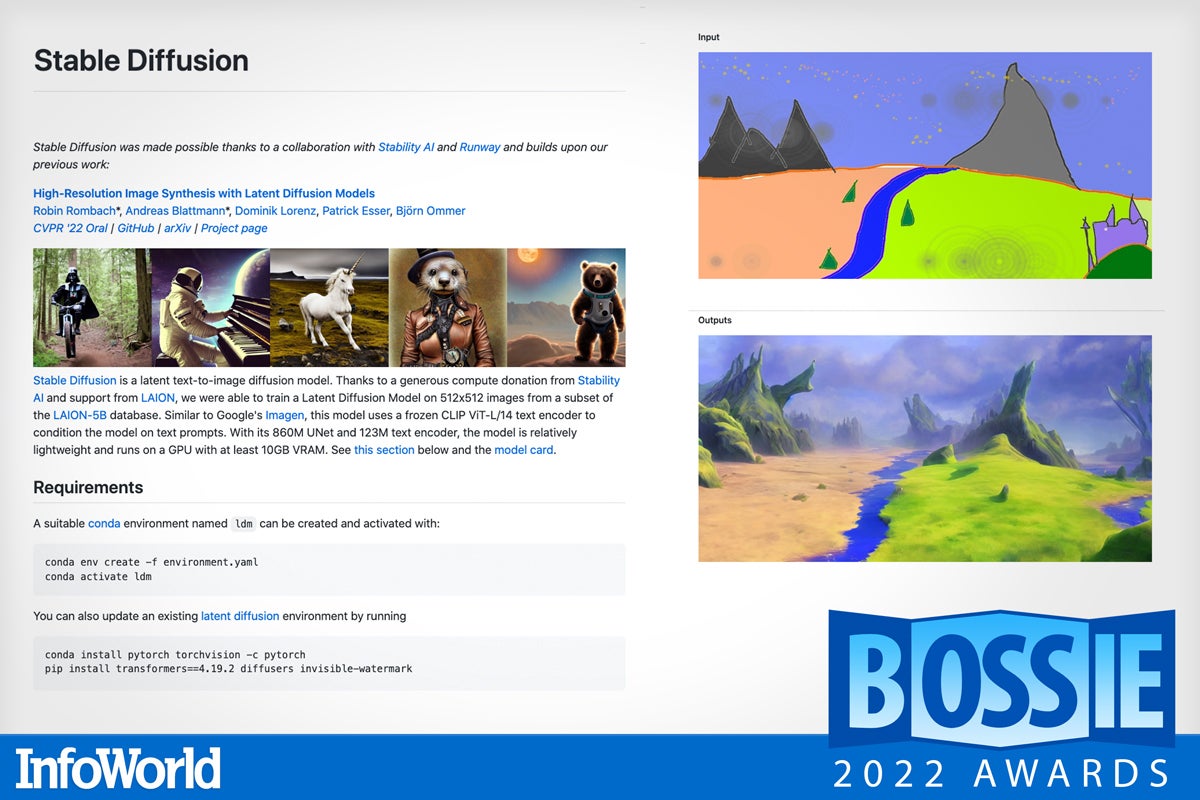

【开源软件】最好的开源软件-2022-第27名 Stable Diffusion

Stable Diffusion是一个文本到图像的人工智能模型,可以生成质量惊人的图像。该项目成立仅两个月,就如野火般蔓延,世界各地的爱好者已经在对原作进行改进,以加快生成速度,在内存较低的GPU上运行,并增加内画和外画支持。他们甚至在M1驱动的MacBooks上运行了Stable Diffusion。

Stability.ai花了60万美元训练这个模型,并立即将其作为开源(与OpenAI的DALL-E形成对比)。虽然这样的模型肯定会引发人们对数据集管理和创建NSFW图像的能力的担忧,但几乎可以肯定的是,这项技术最好掌握在每个人手中,而不仅仅是少数几家大公司手中,无论是为了推进研究,还是为了在未来几年创作艺术作品。——Ian Pointer

【LangChain】与文档聊天:将OpenAI与LangChain集成的终极指南

欢迎来到人工智能的迷人世界,在那里,人与机器之间的通信越来越模糊。在这篇博客文章中,我们将探索人工智能驱动交互的一个令人兴奋的新前沿:与您的文本文档聊天!借助OpenAI模型和创新的LangChain框架的强大组合,您现在可以将静态文档转化为交互式对话。

你准备好彻底改变你使用文本文件的方式了吗?然后系好安全带,深入了解我们将OpenAI与LangChain集成的终极指南,我们将一步一步地为您介绍整个过程。

什么是LangChain?

LangChain是一个强大的框架,旨在简化大型语言模型(LLM)应用程序的开发。通过为各种LLM、提示管理、链接、数据增强生成、代理编排、内存和评估提供单一通用接口,LangChain使开发人员能够将LLM与真实世界的数据和工作流无缝集成。该框架允许LLM通过合并外部数据源和编排与不同组件的交互序列,更有效地解决现实世界中的问题。

我们将在下面的示例应用程序中使用该框架从文本文档源生成嵌入,并将这些内容持久化到Chroma矢量数据库中。然后,我们将使用LangChain在后台使用OpenAI语言模型来查询用户提供的问题,以处理请求。

这将使我们能够与自己的文本文档聊天。

【生成人工智能】Ray如何解决生成人工智能基础设施的常见生产挑战

这是我们生成人工智能博客系列的第一部分。在这篇文章中,我们讨论了如何使用Ray来生产常见的生成模型工作负载。即将发布的一篇博客将深入探讨Alpa等项目为什么要使用Ray来扩展大型模型。

生成的图像和语言模型有望改变企业的设计、支持、开发等方式。本博客重点关注围绕基础模型支持工作负载生产部署的基础设施挑战,以及Ray,一个用于扩展ML工作负载的领先解决方案,如何应对这些挑战。最后,我们制定了一个改进路线图,以使事情变得更容易。

如今,领先的人工智能组织使用Ray大规模训练大型语言模型(LLM)(例如,OpenAI训练ChatGPT,Cohere训练其模型,EleutherAI训练GPT-J,Alpa训练多节点训练和服务)。然而,这些模型之所以如此令人兴奋,其中一个原因是可以对开源版本进行微调和部署,以解决特定问题,而无需从头开始训练。事实上,社区中的用户越来越多地询问如何使用Ray来协调他们自己的生成人工智能工作负载,建立由大型玩家训练的基础模型。

在下表中,我们用绿色突出显示了常见的“生产规模”需求(通常从1-100个节点开始)。这包括以下问题:

【开发工具】7人工智能驱动的开发工具:改变发展格局

人工智能正在改变世界,软件开发也不例外。人工智能正在帮助开发人员创建比以往任何时候都更快、更智能、更高效的应用程序。在这篇文章中,我们将讨论7种人工智能驱动的工具,它们正在为开发者改变游戏。

1. TabNine